【解锁未来:深入了解机器学习的核心技术与实际应用】

解锁未来:深入了解机器学习的核心技术与实际应用

🚀欢迎互三👉: 2的n次方_⭐⭐

💎1.引言

机器学习(Machine Learning)是人工智能(AI)的一个重要分支,旨在让计算机系统从数据中学习并自动改进。它已经在许多领域产生了深远的影响,如图像识别、语音识别、自然语言处理和推荐系统等。在这篇博客中,我们将探讨机器学习的基础概念、常用算法和实际应用。

💎1.1 什么是机器学习?

机器学习是一种通过数据和统计方法来训练模型,从而使计算机能够执行特定任务而无需显式编程的方法。其核心思想是通过算法让计算机从数据中发现规律,并根据这些规律对新数据做出预测或决策。

💎2 机器学习的分类

机器学习主要分为三类:

监督学习(Supervised Learning):模型在已标注的数据集上进行训练。常见任务包括分类(如垃圾邮件检测)和回归(如房价预测)。

无监督学习(Unsupervised Learning):模型在未标注的数据集上进行训练。常见任务包括聚类(如客户分群)和降维(如主成分分析)。

强化学习(Reinforcement Learning):模型通过与环境的交互来学习,通过奖励和惩罚机制来优化决策过程。常见应用包括游戏AI和机器人控制。

💎3 常用的机器学习算法

💎3.1 线性回归(Linear Regression)

线性回归是一种用于回归任务的简单算法,其目标是找到输入变量和输出变量之间的线性关系。通过最小化残差平方和来拟合一条最佳的直线。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression

# 生成示例数据

X = np.array([[1], [2], [3], [4], [5]])

y = np.array([1, 3, 2, 5, 4])

# 创建线性回归模型并进行训练

model = LinearRegression()

model.fit(X, y)

# 预测

y_pred = model.predict(X)

# 可视化

plt.scatter(X, y, color='blue')

plt.plot(X, y_pred, color='red')

plt.xlabel('X')

plt.ylabel('y')

plt.title('Linear Regression')

plt.show()

💎3.2 逻辑回归(Logistic Regression)

逻辑回归用于二分类问题,通过逻辑函数(Sigmoid)将输入映射到0到1之间的概率值,然后根据概率值进行分类。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import LogisticRegression

# 生成示例数据

X = np.array([[1], [2], [3], [4], [5], [6]])

y = np.array([0, 0, 0, 1, 1, 1])

# 创建逻辑回归模型并进行训练

model = LogisticRegression()

model.fit(X, y)

# 预测

X_test = np.array([[2], [3], [5]])

y_pred = model.predict(X_test)

# 可视化

plt.scatter(X, y, color='blue')

plt.scatter(X_test, y_pred, color='red')

plt.xlabel('X')

plt.ylabel('y')

plt.title('Logistic Regression')

plt.show()

💎3.3 决策树(Decision Tree)

决策树通过树状结构进行决策,每个节点表示一个特征,分支表示特征可能的取值,叶节点表示分类结果。决策树直观且易于解释,但容易过拟合。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.tree import DecisionTreeClassifier

from sklearn import tree

# 生成示例数据

X = np.array([[0, 0], [1, 1], [1, 0], [0, 1]])

y = np.array([0, 1, 1, 0])

# 创建决策树模型并进行训练

model = DecisionTreeClassifier()

model.fit(X, y)

# 预测

y_pred = model.predict([[0, 0], [1, 1]])

# 可视化决策树

plt.figure(figsize=(12, 8))

tree.plot_tree(model, filled=True, feature_names=['Feature 1', 'Feature 2'])

plt.title('Decision Tree')

plt.show()

💎3.4 支持向量机(SVM)

SVM用于分类任务,通过寻找一个最优超平面来最大化类别间的间隔,从而实现分类。SVM在高维空间中表现良好,适用于小规模数据集。

import numpy as np

import matplotlib.pyplot as plt

from sklearn import datasets

from sklearn.svm import SVC

# 生成示例数据

X, y = datasets.make_blobs(n_samples=50, centers=2, random_state=6)

# 创建SVM模型并进行训练

model = SVC(kernel='linear')

model.fit(X, y)

# 获取支持向量

support_vectors = model.support_vectors_

# 可视化

plt.scatter(X[:, 0], X[:, 1], c=y, cmap='winter')

plt.scatter(support_vectors[:, 0], support_vectors[:, 1], color='red')

plt.xlabel('Feature 1')

plt.ylabel('Feature 2')

plt.title('Support Vector Machine')

plt.show()

💎3.5 神经网络(Neural Networks)

神经网络模仿生物神经网络结构,由输入层、隐藏层和输出层组成。通过反向传播算法进行训练,适用于复杂的非线性问题。深度学习(Deep Learning)是神经网络的一个子集,包含多层隐藏层。

import numpy as np

from keras.models import Sequential

from keras.layers import Dense

# 生成示例数据

X = np.array([[0, 0], [0, 1], [1, 0], [1, 1]])

y = np.array([[0], [1], [1], [0]])

# 创建神经网络模型

model = Sequential()

model.add(Dense(4, input_dim=2, activation='relu'))

model.add(Dense(1, activation='sigmoid'))

# 编译模型

model.compile(loss='binary_crossentropy', optimizer='adam', metrics=['accuracy'])

# 训练模型

model.fit(X, y, epochs=1000, verbose=0)

# 预测

y_pred = model.predict(X)

print("Predictions:", y_pred)

💎4. 机器学习的实际应用

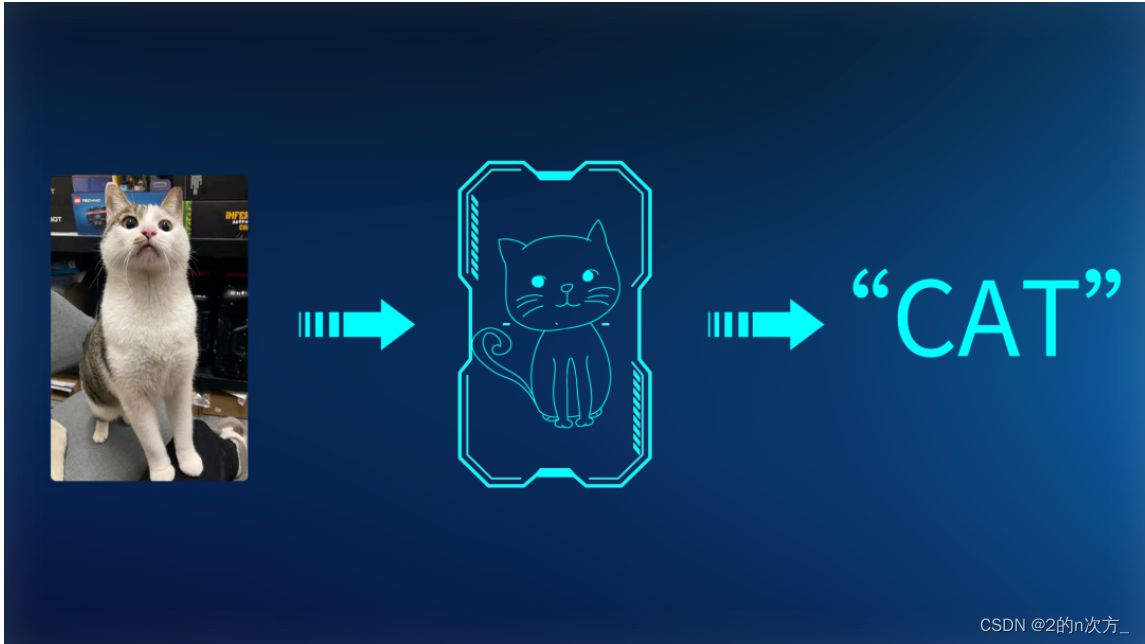

图像识别

图像识别技术在计算机视觉领域取得了巨大进展。卷积神经网络(CNN)是处理图像数据的主要工具,广泛应用于人脸识别、自动驾驶、医学影像分析等领域。

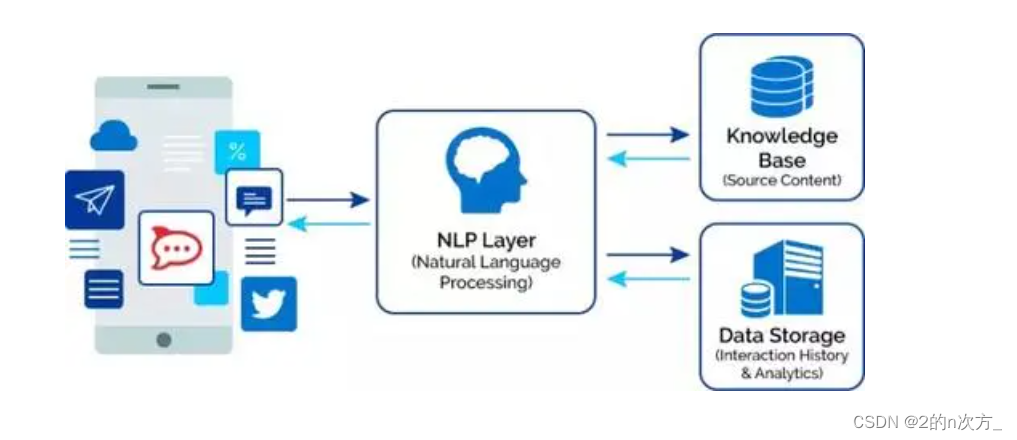

自然语言处理(NLP)

NLP技术使计算机能够理解和生成人类语言。常见应用包括机器翻译(如Google Translate)、语音识别(如Siri)和情感分析(如社交媒体监控)。

推荐系统

推荐系统通过分析用户的历史行为和兴趣,为其提供个性化的推荐内容。常见应用包括电子商务(如亚马逊推荐商品)、流媒体(如Netflix推荐电影)和社交媒体(如Facebook推荐朋友)。

💎5. 机器学习的挑战与未来

尽管机器学习在许多领域取得了显著成就,但仍面临许多挑战:

数据质量和数量:高质量的大规模数据集是训练高性能模型的基础,然而获取和处理这些数据往往耗时耗力。

模型解释性:复杂模型(如深度神经网络)难以解释其决策过程,这在某些应用场景中(如医疗诊断)是一个重要问题。

算法公平性:机器学习模型可能会继承和放大数据中的偏见,导致不公平的决策结果。因此,需要研究如何设计公平且透明的算法。

未来,机器学习将继续与其他技术(如物联网、边缘计算)深度融合,推动智能化应用的发展。同时,研究人员将致力于解决当前的挑战,进一步提升机器学习的性能和应用范围。