基于本地知识库的 ChatGLM 等大语言模型应用实现

基于本地知识库的 ChatGLM 等大语言模型应用实现

介绍

🤖️ 一种利用 langchain 思想实现的基于本地知识库的问答应用,目标期望建立一套对中文场景与开源模型支持友好、可离线运行的知识库问答解决方案。

💡 受 GanymedeNil 的项目 document.ai 和 AlexZhangji 创建的 ChatGLM-6B Pull Request 启发,建立了全流程可使用开源模型实现的本地知识库问答应用。现已支持使用 ChatGLM-6B 等大语言模型直接接入,或通过 fastchat api 形式接入 Vicuna, Alpaca, LLaMA, Koala, RWKV 等模型。

✅ 本项目中 Embedding 默认选用的是 GanymedeNil/text2vec-large-chinese,LLM 默认选用的是 ChatGLM-6B。依托上述模型,本项目可实现全部使用开源模型离线私有部署。

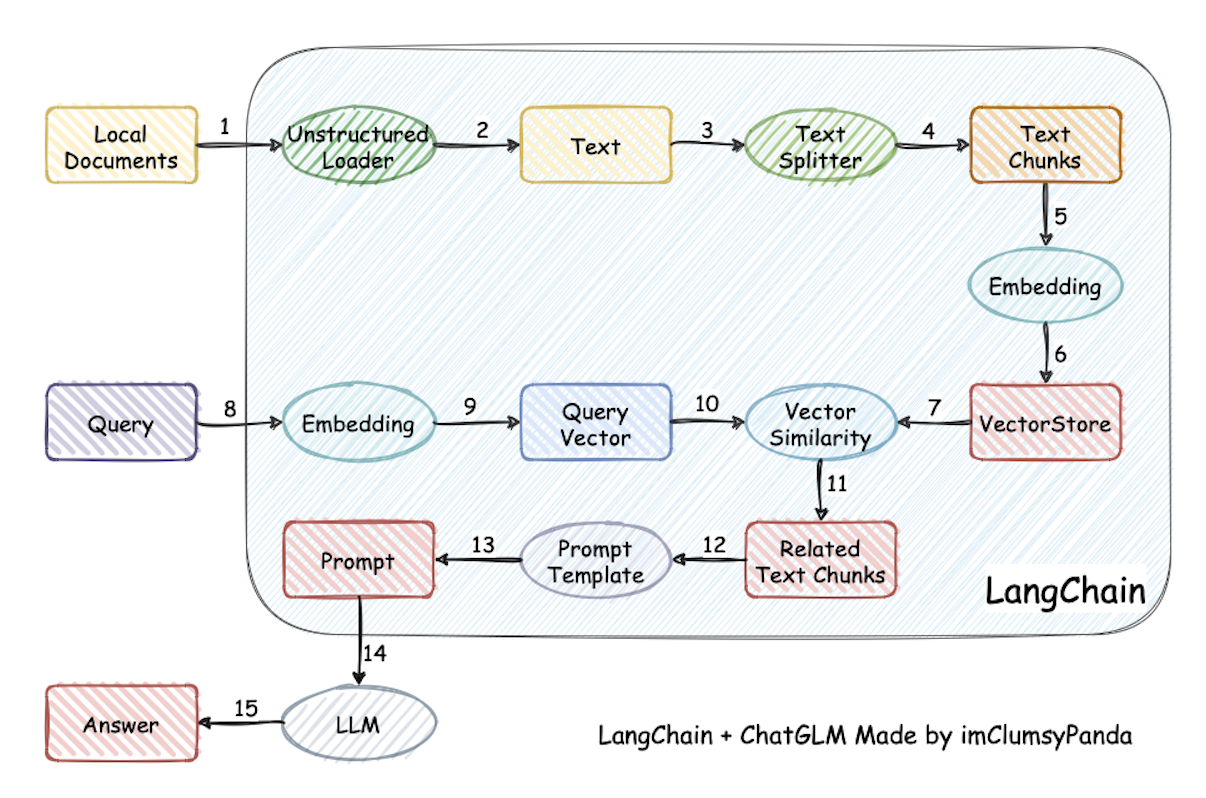

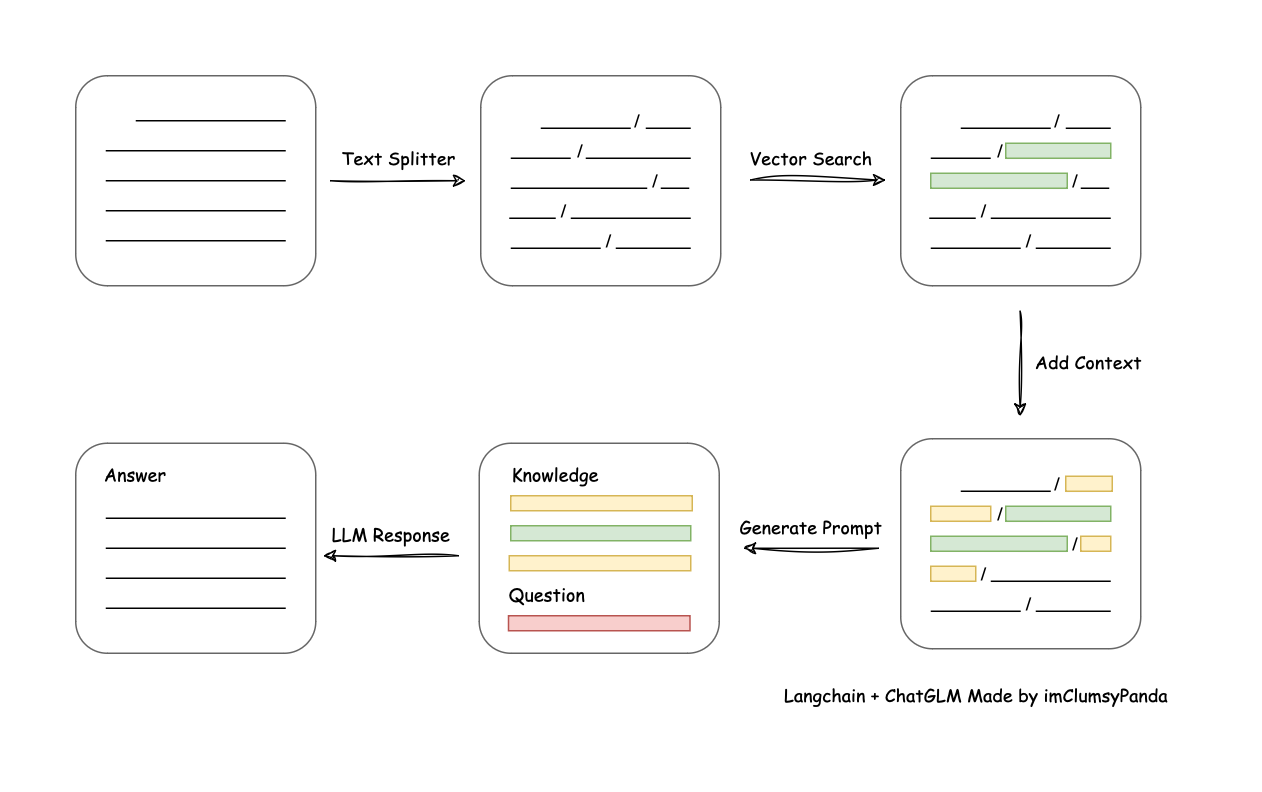

⛓️ 本项目实现原理如下图所示,过程包括加载文件 -> 读取文本 -> 文本分割 -> 文本向量化 -> 问句向量化 -> 在文本向量中匹配出与问句向量最相似的top k个 -> 匹配出的文本作为上下文和问题一起添加到prompt中 -> 提交给LLM生成回答。

从文档处理角度来看,实现流程如下:

🚩 本项目未涉及微调、训练过程,但可利用微调或训练对本项目效果进行优化。

变更日志

参见 变更日志。

硬件需求

ChatGLM-6B 模型硬件需求

注:如未将模型下载至本地,请执行前检查

$HOME/.cache/huggingface/文件夹剩余空间,模型文件下载至本地需要 15 GB 存储空间。

注:一些其它的可选启动项见项目启动选项

模型下载方法可参考 常见问题 中 Q8。量化等级 最低 GPU 显存(推理) 最低 GPU 显存(高效参数微调) FP16(无量化) 13 GB 14 GB INT8 8 GB 9 GB INT4 6 GB 7 GB MOSS 模型硬件需求

注:如未将模型下载至本地,请执行前检查

$HOME/.cache/huggingface/文件夹剩余空间,模型文件下载至本地需要 70 GB 存储空间模型下载方法可参考 常见问题 中 Q8。

量化等级 最低 GPU 显存(推理) 最低 GPU 显存(高效参数微调) FP16(无量化) 68 GB - INT8 20 GB - Embedding 模型硬件需求

本项目中默认选用的 Embedding 模型 GanymedeNil/text2vec-large-chinese 约占用显存 3GB,也可修改为在 CPU 中运行。

Docker 部署

为了能让容器使用主机GPU资源,需要在主机上安装 NVIDIA Container Toolkit。具体安装步骤如下:

1 | |

安装完成后,可以使用以下命令编译镜像和启动容器:

1 | |

开发部署

软件需求

本项目已在 Python 3.8 - 3.10,CUDA 11.7 环境下完成测试。已在 Windows、ARM 架构的 macOS、Linux 系统中完成测试。

vue前端需要node18环境

从本地加载模型

1. 安装环境

参见 安装指南。

2. 设置模型默认参数

在开始执行 Web UI 或命令行交互前,请先检查 configs/model_config.py 中的各项模型参数设计是否符合需求。

如需通过 fastchat 以 api 形式调用 llm,请参考 fastchat 调用实现

3. 执行脚本体验 Web UI 或命令行交互

注:鉴于环境部署过程中可能遇到问题,建议首先测试命令行脚本。建议命令行脚本测试可正常运行后再运行 Web UI。

执行 cli_demo.py 脚本体验命令行交互:

1 | |

或执行 webui.py 脚本体验 Web 交互

1 | |

或执行 api.py 利用 fastapi 部署 API

1 | |

或成功部署 API 后,执行以下脚本体验基于 VUE 的前端页面

1 | |

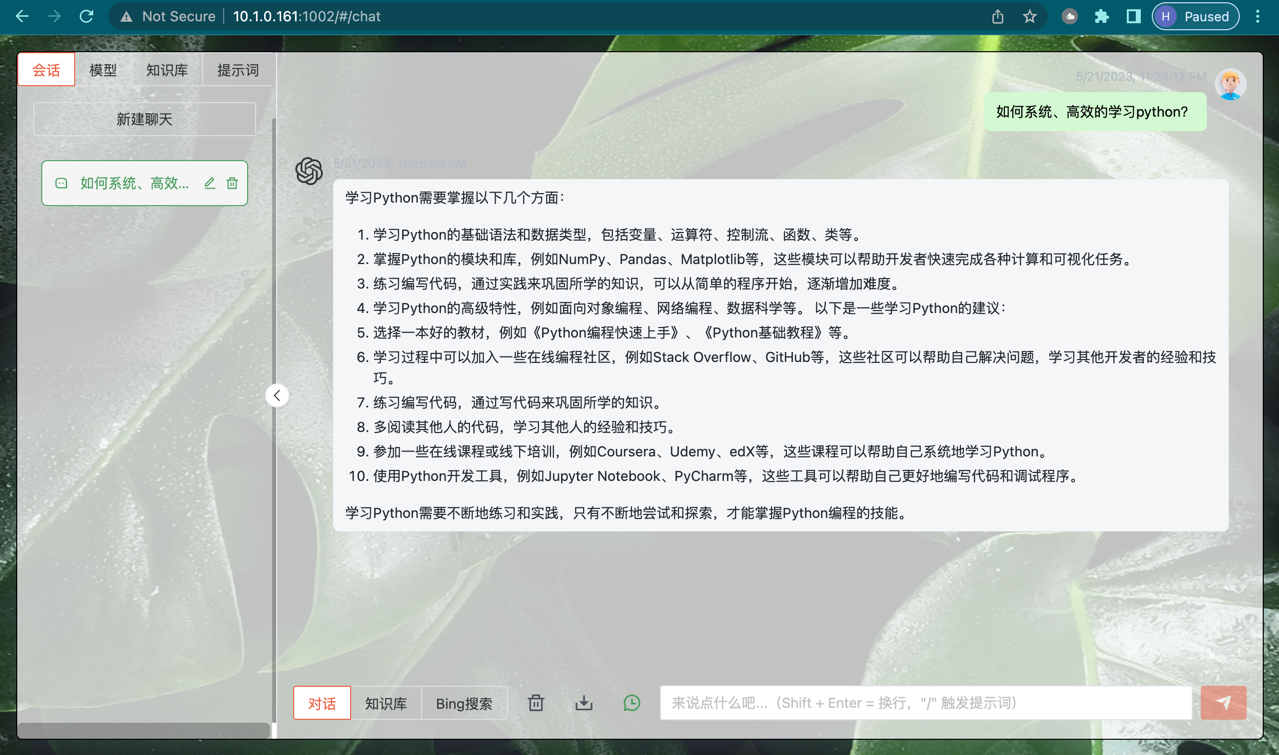

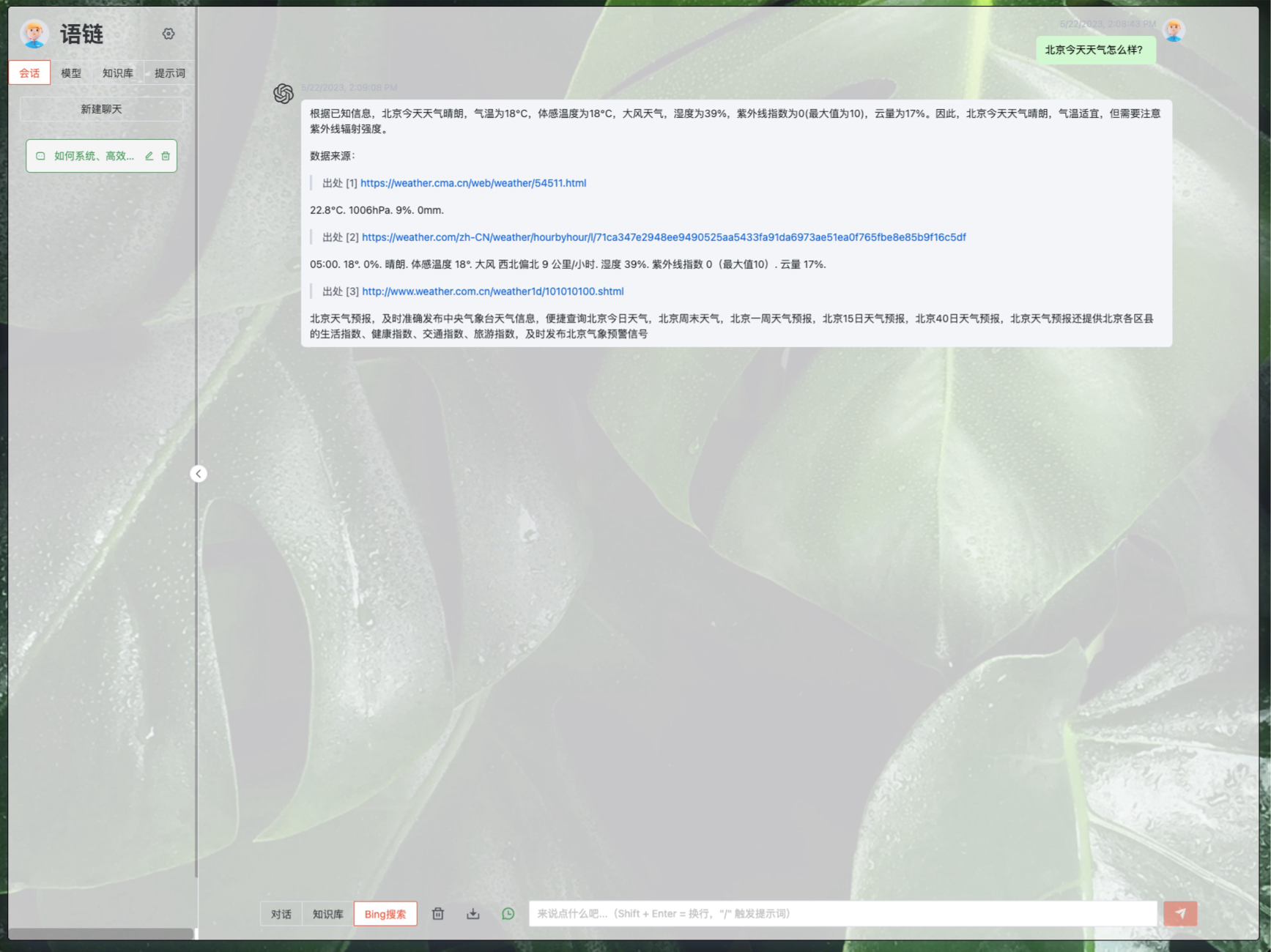

VUE 前端界面如下图所示:

对话界面

知识库问答界面

Bing搜索界面

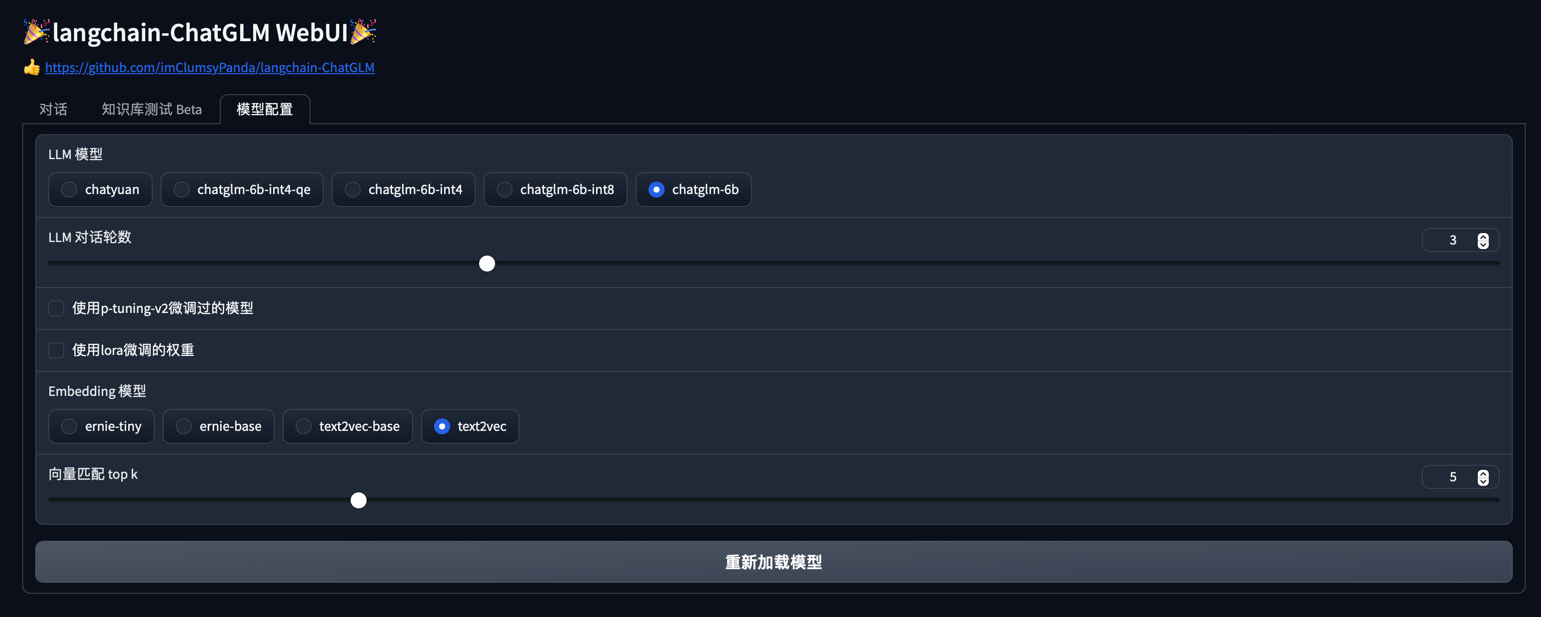

WebUI 界面如下图所示:

对话Tab 界面

知识库测试 BetaTab 界面

模型配置Tab 界面

Web UI 可以实现如下功能:

- 运行前自动读取

configs/model_config.py中LLM及Embedding模型枚举及默认模型设置运行模型,如需重新加载模型,可在模型配置Tab 重新选择后点击重新加载模型进行模型加载; - 可手动调节保留对话历史长度、匹配知识库文段数量,可根据显存大小自行调节;

对话Tab 具备模式选择功能,可选择LLM对话与知识库问答模式进行对话,支持流式对话;- 添加

配置知识库功能,支持选择已有知识库或新建知识库,并可向知识库中新增上传文件/文件夹,使用文件上传组件选择好文件后点击上传文件并加载知识库,会将所选上传文档数据加载至知识库中,并基于更新后知识库进行问答; - 新增

知识库测试 BetaTab,可用于测试不同文本切分方法与检索相关度阈值设置,暂不支持将测试参数作为对话Tab 设置参数。 - 后续版本中将会增加对知识库的修改或删除,及知识库中已导入文件的查看。

常见问题

参见 常见问题。

Demo

以问题chatglm-6b 的局限性具体体现在哪里,如何实现改进为例:

未使用 langchain 接入本地文档时:

ChatGLM-6B 是一个基于 GPT-3 的聊天机器人,它的局限性主要体现在以下几个方面:

- 语言模型的精度:GPT-3 是一种大型的语言模型,它的精度比较高,但是仍然有一些局限性。例如,它可能无法准确地理解某些方言、口音或者复杂的句子结构。

- 知识图谱的完整性:GPT-3 可以生成一些知识图谱,但是其完整性和准确性可能不够。例如,它可能无法准确地理解某些领域的专业知识和术语。

- 对话生成的连贯性:GPT-3 可以生成一些连贯的对话,但是其生成的对话可能不够自然。例如,它可能会生成一些虚假的、不连贯的对话或者误解用户的意图。

为了改进 ChatGLM-6B,可以考虑以下几个方面:

- 提高语言模型的精度:可以通过增加训练数据、使用更好的语言模型架构、优化模型训练过程等方式来提高语言模型的精度。

- 增强知识图谱的完整性:可以通过增加知识图谱的维度、使用更好的知识图谱构建方法、优化知识图谱的匹配算法等方式来增强知识图谱的完整性。

- 提高对话生成的连贯性:可以通过增加对话生成模型的上下文信息、使用更好的上下文信息提取方法、优化对话生成模型的算法等方式来提高对话生成的连贯性。

- 引入更多的人类反馈:人类反馈可以帮助 ChatGLM-6B 更好地理解用户的意图和需求,从而提高对话生成的质量和准确性。可以通过引入更多的人类客服、使用人类反馈收集器等方式来引入更多的人类反馈。

使用 langchain 接入 ChatGLM-6B 项目的 README.md 文件后 ChatGLM 的回答:

ChatGLM-6B 是一个基于深度学习的自然语言处理模型,它在回答问题方面表现出色。但是,它也有一些局限性,具体如下:

- 语言理解有限:ChatGLM-6B 只学习了中文自然语言,对于其他语言可能会存在理解上的局限性。

- 知识储备不足:ChatGLM-6B 的训练数据集只包含了中文语料,因此它可能无法回答一些非中文的问题或者某些特定领域的问题。

- 数据量有限:ChatGLM-6B 的训练数据集只有几百万条记录,因此它可能无法回答一些非常具体或者复杂的问题。

为了改进 ChatGLM-6B,可以考虑以下几个方面:

- 学习更多的语言知识:可以学习其他语言的自然语言处理技术,扩大语言理解的范围。

- 扩大知识储备:可以收集更多的中文语料,或者使用其他语言的数据集来扩充知识储备。

- 增加数据量:可以使用更大的数据集来训练 ChatGLM-6B,提高模型的表现。

- 引入更多的评估指标:可以引入更多的评估指标来评估模型的表现,从而发现 ChatGLM-6B 存在的不足和局限性。

- 改进模型架构:可以改进 ChatGLM-6B 的模型架构,提高模型的性能和表现。例如,可以使用更大的神经网络或者改进的卷积神经网络结构。

路线图

- Langchain 应用

- 接入非结构化文档(已支持 md、pdf、docx、txt 文件格式)

- jpg 与 png 格式图片的 OCR 文字识别

- 搜索引擎接入

- 本地网页接入

- 结构化数据接入(如 csv、Excel、SQL 等)

- 知识图谱/图数据库接入

- Agent 实现

- 增加更多 LLM 模型支持

- 增加更多 Embedding 模型支持

- Web UI

- 基于 gradio 实现 Web UI DEMO

- 基于 streamlit 实现 Web UI DEMO

- 添加输出内容及错误提示

- 引用标注

- 增加知识库管理

- 选择知识库开始问答

- 上传文件/文件夹至知识库

- 知识库测试

- 删除知识库中文件

- 支持搜索引擎问答

- 增加 API 支持

- 利用 fastapi 实现 API 部署方式

- 实现调用 API 的 Web UI Demo

- VUE 前端